Modenhedsaudit for ansvarlig AI

Over for de regulatoriske udfordringer i EU’s AI‑forordning (EU AI Act) og de væsentlige risici forbundet med kunstig intelligens – særligt misbrug – understøtter Bureau Veritas jer med en omfattende modenhedsaudit, der har til formål at vurdere og sikre jeres generative AI‑systemer, jeres AI‑projekter og jeres organisatoriske kapabiliteter. Denne tilgang indgår i en transformationslogik, der er tilpasset virksomhedens rolle i AI‑værdikæden samt de involverede kompetencer.

Forudse regulatorisk efterlevelse og styrk interessenternes tillid gennem en struktureret metodik.

Hvad er en AI‑modenhedsaudit?

En AI‑modenhedsaudit er en omfattende og struktureret vurdering af en organisations evne til at udvikle, styre og effektivt implementere løsninger baseret på kunstig intelligens – inden for en ramme, der understøtter transformation, kompetenceudvikling og overholdelse af EU’s AI‑forordning (European AI Act).

Bureau Veritas kan støtte jer som en uafhængig og betroet tredjepart.

Auditten analyserer en række centrale områder, herunder AI‑strategi, datastyring, modelkvalitet, risikostyring, regulatorisk compliance, interne kompetencer, teknisk infrastruktur samt centrale AI‑relaterede færdigheder. Den vurderer organisationens modenhed på en trinvis skala og identificerer både styrker, der kan bygges videre på, og områder, som kræver prioriterede forbedringer.

AI‑modenhedsaudit giver en klar køreplan for at styrke organisatoriske kapabiliteter og kompetencer, optimere teknologiinvesteringer og understøtte en ansvarlig og bæredygtig AI‑transformation.

Hvorfor bør du få støtte til din modenhedsaudit inden for ansvarlig AI?

En regulatorisk kontekst med EU’s AI‑forordning

(EU AI Act)

Med virkning fra 1. august 2024 pålægger EU’s AI‑forordning (EU AI Act) virksomheder, der anvender AI‑systemer og behandler data, skrappe forpligtelser afhængigt af organisationens rolle – uanset anvendelsesscenarier eller konkrete AI‑projekter.

Forordningen bliver bindende fra 2. august 2026, særligt for højrisiko‑AI‑systemer samt systemer, der er omfattet af gennemsigtighedskrav vedrørende de anvendte data.

Med bøder på op til 7 %* af den globale omsætning er compliance en absolut nødvendighed.

En kompleks udfordring for virksomheder

Tallene taler for sig selv:

- 68 % af virksomhederne ** har vanskeligt ved at fortolke EU’s AI‑forordning (EU AI Act) og forstå dens betydning for deres AI‑projekter, data og interne organisering.

- 72 % af topledere * mener, at deres organisationer ikke er forberedt på EU’s AI‑forordning (EU AI Act) og de konsekvenser, den medfører.

- 60 % af multinationale virksomheder *** har ikke implementeret de krævede rammer for AI‑ og datagovernance, der er tilpasset deres organisatoriske rolle, som følge af manglende strukturerede kompetencer.

Flere risici der skal håndteres

AI‑systemer indebærer tre overordnede kategorier af risici, som relaterer sig til data, modeller og forretningsmæssige anvendelsesscenarier:

- Ondsindet anvendelse: cyberangreb, desinformation, udvikling af biologiske våben samt misbrug af data

- Funktionsfejl: algoritmisk bias, datarelaterede pålidelighedsfejl samt tab af kontrol over autonome systemer

- Systemiske risici: beskyttelse af personoplysninger og miljøpåvirkning

Hvordan klassificerer EU’s AI‑forordning (EU AI Act) AI‑systemer?

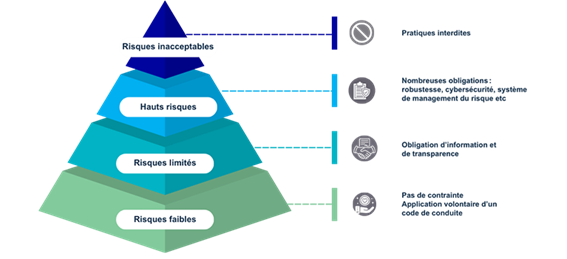

EU’s AI‑forordning strukturerer sine forpligtelser omkring fire risikoniveauer:

uacceptabel risiko, høj risiko, begrænset risiko og minimal risiko, afhængigt af projektet, det forretningsmæssige formål, de behandlede data samt organisationens rolle.

AI‑modenhedsvurdering: Et enkelt rammeværk til risikostyring

Hvad bliver vurderet?

Bureau Veritas assesses generative AI systems used in conversational agents (e.g., chatbots), considering:

- data used

- models

- processes

- internal competencies

- associated governance

Objective: manage Responsible AI risks and ensure safe and compliant use.

Bureau Veritas vurderer generative AI‑systemer anvendt i samtalebaserede løsninger (fx chatbots) med fokus på:

- anvendte data

- modeller

- processer

- interne kompetencer

- tilhørende governance

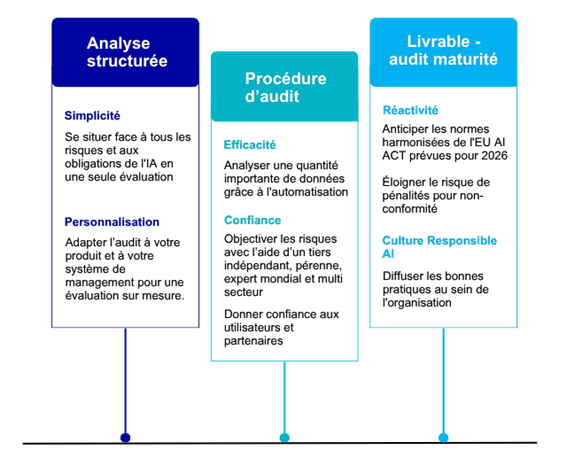

En struktureret analyse

En unik vurdering baseret på otte standardiserede søjler fra EU’s AI‑forordning (EU AI Act), som dækker både regulatoriske forpligtelser og god praksis inden for datastyring:

- forklarbarhed

- kontrolbarhed

- gennemsigtighed

- sikkerhed

- retfærdighed

- governance

- fortrolighed og informationssikkerhed

- robusthed og nøjagtighed

Denne vurdering forfines ved anvendelse af internationale standarder såsom NIST, ISO 42001, ISO/IEC 24027 m.fl.

En komplet auditproces

- Præ‑audit: vurdering af AI‑systemets anvendelighed

- Automatiseret dokumentationsaudit: analyse af processer og dokumentation

- Audit på lokation: evaluering i samarbejde med jeres operationelle teams

- Automatiserede direkte tests: direkte anvendelse af AI‑systemet for at teste kritiske egenskaber

Leverance: Rapport om AI‑modenhed

- Detaljeret rapport, der styrker tilliden hos interessenter

Handlingsorienterede anbefalinger til forbedring af overholdelse af krav

- Evaluering tilpasset AI‑systemets risikoniveau i overensstemmelse med klassificeringen i EU’s AI‑forordning (EU AI Act)

AWS og AIRI — AI‑teknologi til effektiv auditering

AWS stiller teknologiske kapabiliteter til rådighed for Bureau Veritas, som driver AIRI (AI Risk Intelligence) – en central del af processen for modenhedsaudit af ansvarlig AI.

Denne proces automatiserer analysen af store datamængder, hvilket gør auditten mere effektiv og hurtigere, samtidig med at mennesker fortsat er i centrum.

Leverancemodellen er baseret på AWS‑infrastruktur og anvendes til at evaluere de otte standardiserede søjler: forklarbarhed, refærdighed, governance, fortrolighed og informationssikkerhed, sikkerhed, kontrolbarhed, robusthed og nøjagtighed samt gennemsigtighed.

Fordele ved modenhedsaudit for ansvarlig AI

Tre centrale områder:

- Enkelhed og tilpasning gennem struktureret analyse

- Effektivitet og tillid i auditprocessen

Handlekraft og en kultur for ansvarlig AI, understøttet af auditleverancen

Hvorfor vælge Bureau Veritas?

En innovativ og omfattende løsning:

- 100 % dækning af forpligtelserne i EU’s AI‑forordning (EU AI Act) for både idriftsættere og udbydere af generative AI‑systemer

- Integration af internationalt best practices for en pålidelig og anerkendt vurdering

- Anerkendt ekspertise inden for risiko‑ og kvalitetsstyringssystemer

- Avanceret automatisering med proprietære IT‑værktøjer, herunder en “Judge LLM”

- Garanteret menneskelig kontrol: godkendte auditorer fortolker dataene

Ofte stillede spørgsmål

-

Hvad er en modenhedsvurdering af AI‑data?

En systematisk analyse af kvaliteten, governance og beredskabet for de data, der anvendes til at træne og drive AI‑systemer. Analysen omfatter dimensioner som fuldstændighed, nøjagtighed, relevans, tilgængelighed og overholdelse af regulatoriske krav.

Den identificerer mangler, potentielle bias og risici relateret til datakvalitet og vejleder i forbedringer for at sikre robust ydeevne og pålidelighed i AI‑modeller. -

What is Responsible AI?

Ansvarlig AI refererer til principper, praksisser og governance, der har til formål at udvikle og idriftsætte AI‑systemer på en etisk, gennemsigtig måde og i overensstemmelse med samfundets værdier. Det bygger på gennemsigtighed, retfærdighed, ansvarlighed, datasikkerhed og overholdelse af regulatoriske krav.

-

Hvad er de vigtigste forpligtelser i EU’s AI‑forordning (EU AI Act)?

Forpligtelserne varierer afhængigt af risikoniveau:

- Forbud mod systemer med uacceptabel risiko

- Skrappe krav til højrisikosystemer (overensstemmelsesvurdering, teknisk dokumentation, menneskelig kontrol m.m.)

- Gennemsigtighedskrav for systemer med begrænset risiko

-

Hvad er søjlerne i ansvarlig AI?

Otte søjler strukturerer udviklingen, idriftsættelsen og governance af AI‑systemer:

- forklarbarhed

- kontrolbarhed

- gennemsigtighed

- sikkerhed

- retfærdighed

- governance

- fortrolighed og informationssikkerhed

- robusthed og nøjagtighed

-

Hvordan ved jeg, om mit system er højrisiko?

Et system betragtes som højrisiko, hvis det anvendes i kritiske områder som rekruttering, uddannelse, sundhedsvæsen eller offentlige tjenester. Denne vurdering kan hurtigt foretages ved hjælp af EU AI Act Compliance Checker.

Bureau Veritas kan understøtte denne proces for regulatorisk klassificering. -

Hvad hvis mit AI‑system ikke er højrisiko?

Selv hvis et AI‑system ikke er højrisiko, er det fortsat afgørende at håndtere AI‑relaterede risici. Utilstrækkelig governance kan hæmme implementeringen og skade organisationens omdømme.

Modenhedsaudit for ansvarlig AI hjælper organisationer med proaktivt at vurdere og styre AI‑risici. -

Hvor lang tid tager en AI‑modenhedsaudit?

Varigheden afhænger af:

- kompleksiteten og antallet af anvendelsesscenarier

- det tilknyttede risikoniveau

- jeres organisations rolle (udbyder eller idriftsætter)

I gennemsnit:

En standard indledende audit kræver omkring 5 dages indsats fra jeres teams og 20 dages arbejde fra vores teams.

Efterfølgende audits gennemføres hurtigere som følge af automatisering og øget modenhed. -

Hvordan forbereder jeg mig på en AI‑modenhedsaudit?

Koordiner med følgende roller:

- Product Owner for AI‑anvendelsesscenariet

- Forretningsrepræsentant

- Ansvarlig for AI‑governance

- Repræsentant for IT, cybersikkerhed og databeskyttelse

- Om muligt: ansvarlig for kvalitets‑ og risikostyring

Forbered dokumentation, der dokumenterer risikostyring og efterlevelse af AI‑krav.

-

Hvad er de tre hovedgreb i ansvarlig AI?

Forstå og afgræns

Formål: At identificere jeres rolle (udbyder / bruger), jeres AI‑anvendelsesscenarier samt jeres forpligtelser i henhold til EU’s AI‑forordning (EU AI Act).

Vores støtte:

› Diagnose af anvendelighed i forhold til EU’s AI‑forordning

› Klassificering af systemer og anvendelsesscenarier

› Regulatorisk rammesætning og prioritering af risiciVurdér & styr AI‑risici

Formål: Måling og test af risici og mangler relateret til AI‑systemer og kravene i EU’s AI‑forordning (EU AI Act).

Vores støtte:

› Modenhedsaudit i henhold til EU’s AI‑forordning (EU AI Act)

› Analyse af AI‑risici og trusselsmodellering

> Vurdering af modellernes robusthed og forklarbarhed

› Tekniske og sikkerhedsmæssige tests (herunder generativ AI)- Deploy trustworthy AI

Objective: Ensure sustainable compliance and secure adoption of the IAA

Our support:

› Support for the implementation of the Al Act (governance, processes, documentation, etc.)

› Definition of best practices and controls

› Awareness and training of management and operational teams Idriftsæt pålidelig AI

Formål: At sikre bæredygtig efterlevelse og en sikker ibrugtagning af EU’s AI‑forordning (EU AI Act).

Vores støtte:

› Støtte til implementering af EU’s AI‑forordning (EU AI Act)

(governance, processer, dokumentation m.m.)

› Definition af bedste praksis og kontrolforanstaltninger

› Bevidstgørelse og træning af ledelse og operationelle teams

-

Hvad er de vigtigste skridt mod efterlevelse af EU’s AI‑forordning? (EU AI Act)

- Etabler regulatoriske grundlag

› Kortlægning af AI‑systemer

› Analyse af AI‑systemer

Anvendelighed af EU’s AI‑forordning (EU AI Act) (klassificering, roller og forpligtelser)

Formål: At opnå et klart overblik over organisationens AI‑anvendelse for at kunne handle med sikkerhed. - Forstå og opbyg efterlevelse

› Måling af mangler i forhold til efterlevelse

Udarbejdelse af en prioriteret handlingsplan

› Dokumentation af efterlevelse (registre, logfiler, teknisk dokumentation)

› Implementering i overensstemmelse med den regulatoriske tidsplan

Formål: At strukturere indsatserne og integrere EU’s AI‑forordning (EU AI Act) på en smidig og kontrolleret måde. - Dokumentér og oprethold overensstemmelse

› Formelt dokumentere efterlevelse

› Overvågning efter markedsføring og løbende opdateringer

› Periodisk genvurdering af efterlevelse

Formål: At sikre bæredygtig efterlevelse, der følger udviklingen i anvendelsen af AI.

- Etabler regulatoriske grundlag

-

Hvorfor er det vigtigt at verificere AI‑genereret information?

For at sikre pålidelighed og kvalitet i professionelle beslutningsprocesser.

AI kan generere svar, der lyder plausible, men som er forkerte (“hallucinationer”). Uverificerede resultater kan bringe regulatorisk efterlevelse i fare, skade omdømmet og skabe juridiske risici.

Bureau Veritas hjælper med at styre disse risici gennem modenhedsaudits.